![]()

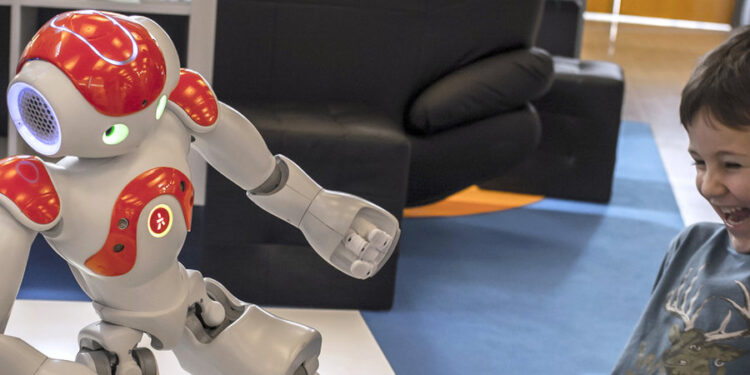

Il faut mieux s’inspirer de la façon dont les enfants développent leur bon sens, dit Gary Marcus, psychologue à l’Université de New York

La société qu’il vient de fonder, Geometric Intelligence, intrigue la communauté des chercheurs en intelligence artificielle, et suscite l’intérêt des géants de l’Internet. Gary Marcus assure qu’il y développe une méthode inédite pour faire apprendre les robots, une technologie inspirée d’un modèle qu’il côtoie tous les jours: son fils de trois ans, en plein développement de son langage. Invité à participer samedi à l’événement TEDxCERN, ce professeur au Département de psychologie de l’Université de New York, où il dirige l’Infant Language Center, n’hésite pas à pourfendre la «fièvre du «deep learning». Cette technique d’apprentissage informatique automatisé est basée sur des «réseaux de neurones», des myriades d’algorithmes entrelacés sur plusieurs couches qui permettent à un système d’apprendre à partir d’une masse d’exemples. Elle a permis des succès retentissants, telle la victoire d’AlphaGo, un ordinateur de Google, sur un humain au jeu de go, jadis réputé pour être le dernier bastion de l’intelligence humaine.

Que reprochez-vous au «deep learning»?

L’on met trop cette technologie sur un piédestal, en affirmant qu’elle révolutionne l’intelligence artificielle (IA), et qu’on peut tout faire avec. Andrew Ng [une sommité du domaine à l’Université de Stanford, aujourd’hui chez Baidu, le Google chinois] affirme que «tout ce qu’une personne peut faire en moins d’une seconde, on peut l’automatiser», soulignant ainsi les progrès et la rapidité d’exécution des robots dotés d’IA. C’est une assertion forte, mais certainement pas vraie. Oui, on peut faire fonctionner une voiture sans pilote – nous-mêmes, lorsque nous conduisons, prenons plusieurs décisions chaque seconde. Mais il manque bien d’autres caractéristiques pour généraliser cette affirmation. Et pour faire par exemple qu’un robot domestique comprenne et exécute instantanément nos requêtes, comme le ferait un humain.

Par exemple?

Du bon sens, qui dépend partiellement d’une compréhension causale des choses. Par exemple, une image d’un homme portant un cheval sur son épaule vous semblera inhabituelle. Or pour une IA qui n’a jamais expérimenté la notion abstraite de force de gravité, cette photo n’aura rien d’absurde. C’est l’opposition que les psychologues font entre la perception et la cognition. Et c’est pour cette raison, notamment, qu’il faut à tout prix éviter de rendre des robots guerriers autonomes.

Est-ce possible d’induire ce type de propriétés, tel le bon sens, dans une machine? Comment?

Ce que les méthodes de «deep learning» font, pour apprendre, c’est reconnaître des schémas dans une très vaste quantité d’exemples dont on doit les nourrir. Or le cerveau humain est clairement capable de faire mieux, en acquérant une plus profonde abstraction à partir de très peu de données. Chez un enfant de 3 ans qui veut connaître le pourquoi causal des choses, la capacité à extrapoler et généraliser des concepts est très sophistiquée. Et même si au final il ne comprend pas tout exactement, il acquiert des notions abstraites. En fait, le cerveau utilise des techniques proches du «deep learning» pour certaines tâches, mais il est aussi capable de développer, enregistrer et manipuler des règles sur le fonctionnement du monde de telle manière qu’il puisse tirer des conclusions aussi à partir d’un petit nombre d’expériences. Il faut s’inspirer de cette idée en intelligence artificielle.

C’est ce que vous faites chez Geometric Intelligence?

Oui. Je ne peux pas entrer dans les détails de ce que l’on développe. Mais je peux expliquer les grandes lignes. Il demeure une forte résistance à voir le cerveau comme un ordinateur. Mais le cerveau en est bien un; il est juste d’un type différent de ceux avec lesquels on travaille. Et on peut rapprocher son fonctionnement de ceux des langages de programmation standard, dans lesquels on écrit des fonctions d’opération, qui sont efficaces même avec un faible nombre d’exemples. Le problème, c’est que la sociologie des sciences a poussé les recherches en IA dans d’autres directions. De mon côté, je pense qu’il y a des fruits à glaner facilement, en appliquant des techniques statistiques modernes à la bonne vieille manière de concevoir l’IA. Lorsque l’on divise un gros problème à traiter en sous-groupes, il apparaît souvent qu’on ne peut plus se reposer sur une large quantité de données pour trouver des solutions à chacun des éléments de ce portfolio de problèmes. Il faut être capable d’extrapoler et généraliser pour prendre en compte les espaces manquant. Nous développons des algorithmes dans ce sens. Et les applications commerciales potentielles sont partout, tant il n’y aura en fait jamais suffisamment de données pour résoudre sans équivoque chaque problème.

Les développer est notamment l’un des buts des grands projets sur le cerveau, comme le Human Brain Project européen mais aussi l’initiative BRAIN aux Etats-Unis, ou sa pendante chinoise. Qu’attendez-vous de ces vastes programmes?

Dans le court terme, des montagnes de données. Mais pas grand-chose encore sur leur signification. Un immense travail intéressant, de qualité, est effectué pour collecter ces données. Mais en général, aujourd’hui, les neurosciences ne sont pas guidées par la théorie. Il faut davantage de théoriciens, et davantage d’argent pour les soutenir. Des chercheurs qui en comprennent autant en biologie qu’en informatique: il faut faire naître une nouvelle génération de scientifiques interdisciplinaires. Franchement, je participe à nombre de conférences, mais je n’entends pas de plan très clair pour avancer dans ce domaine de la théorisation du fonctionnement du cerveau.

Des voix, certaines célèbres, se sont élevées pour mettre en garde contre l’avènement rapide des intelligences artificielles, et des risques associés pour l’humanité. Qu’en pensez-vous?

Il est possible que l’on crée un jour ce qu’on appelle une intelligence artificielle «forte», ou «générale», similaire à celle de l’homme. Ce qui m’intéresse, c’est comment l’on y arrivera. Aujourd’hui, nous avons des systèmes qui reproduisent l’analyse que font nos cortex visuel, ou auditif. Mais aucun ne reproduit bien l’activité de notre cortex frontal [siège du langage, du raisonnement, de la planification]. Selon moi, il n’y a pas de crainte à avoir dans le court terme. AlphaGo est bien plus intelligent que les précédents programmes qui jouent au Go, mais il n’est pas plus malicieux. Mon plus grand souci actuel, lorsque l’on évoque l’élaboration d’intelligences artificielles, est que nous ne disposons aujourd’hui d’aucune régulation sur la manière dont certains acteurs mal intentionnés pourraient les utiliser. Il y a déjà assez à faire là, avant de s’inquiéter de l’avènement de superintelligences.